Um. This “keep seeing” prompt is unacceptable, @Facebook. And despite the video being more than a year old, a friend got this prompt yesterday. Friends at FB, please escalate. This is egregious.

Het oogappeltje van Mark Zuckerberg is helaas weer negatief in het nieuws. Dit keer gaat het over de gezichtsherkenningssoftware van Facebook en een functionaliteit. Facebook-gebruikers kregen de vraag of ze "Video’s over primaten wilde blijven kijken" bij een filmpje waarin zwarte mannen te zien waren. De video had helemaal niets te maken met apen.

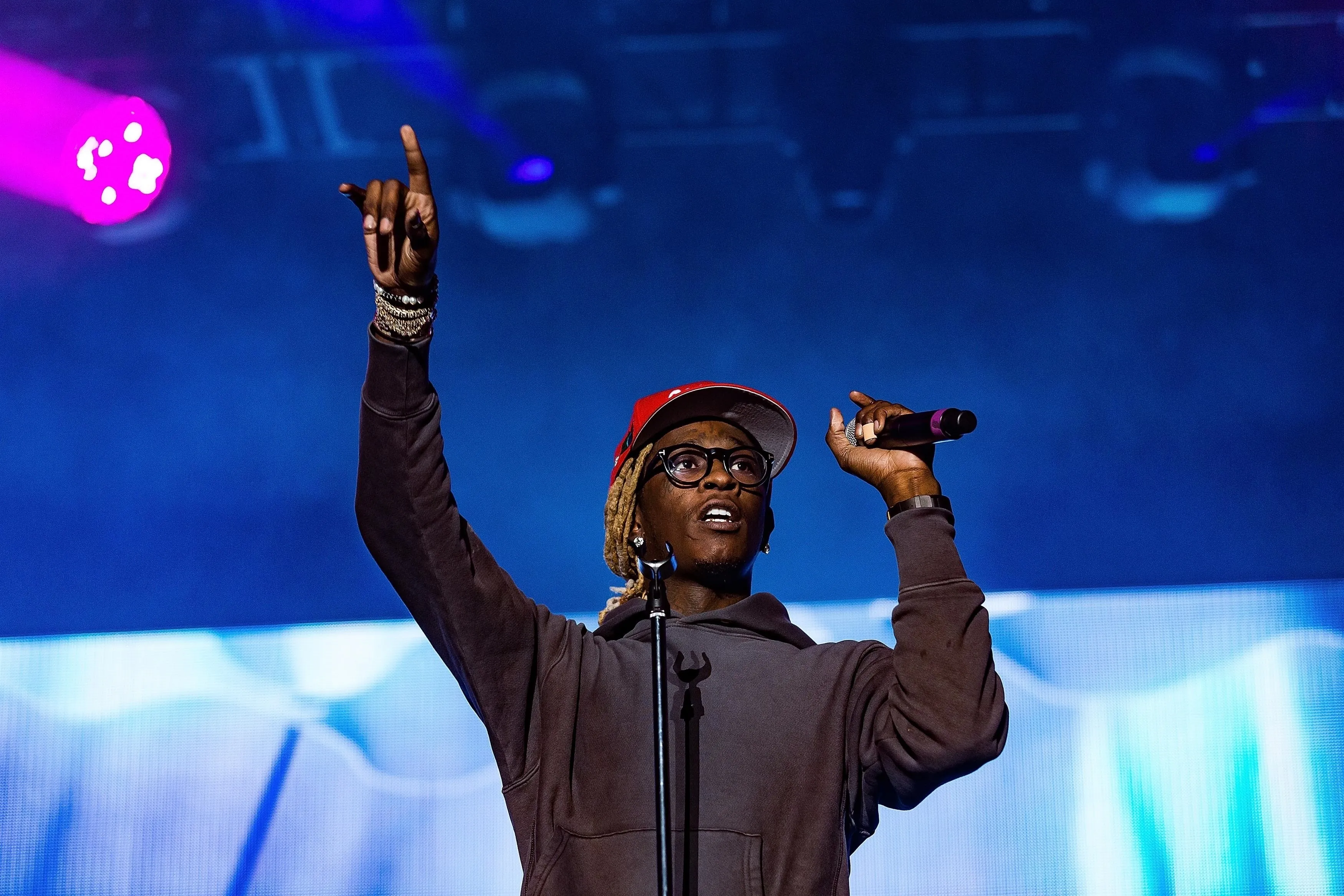

Volgens de New York Times begonnen de problemen recent. De video in kwestie, gepost door de Daily Mail, is getiteld: "Witte man belt politie voor zwarte mannen in de jachthaven." Facebook-gebruikers die de video keken kregen een automatisch gegenereerde pop-up met de vraag.

Facebook schreef in een verklaring dat het om een onaanvaardbare fout gaat. Maar het is niet de eerste keer dat Facebook geconfronteerd werd met beschuldigingen betreffend raciale discriminatie. Ook is de gezichtsherkenningssoftware bekritiseerd door voorvechters van burgerrechten. De problemen van de software zouden vaak gaan om niet witte mensen. In 2020 sloten honderden adverteerders zich aan bij de campagne Stop Hate for Profit. De campagne was georganiseerd door groepen voor sociale rechtvaardigheid, waaronder de Anti-Defamation League (ADL) en Free Press. Dit om Facebook onder druk te zetten om concrete stappen te ondernemen tegen haatzaaiende uitlatingen en verkeerde informatie.

Facebook heeft aangekondigd dat het de functie voor het aanbevelen van onderwerpen heeft uitgeschakeld. De functie zou ervoor moeten zorgen dat video’s in de juiste categorie terecht komen. De uitschakeling is tijdelijk om te kunnen onderzoeken waar het probleem aan ligt.

Gerelateerde artikelen

Laatste artikelen in Muziek

Artist To Watch: Alessio

Alessio de Martino wist al op jonge leeftijd hoe je via social media je eigen succes kan creëren en bouwde sinds 2019 zijn online following op. In 2022 begon hij met het uitbrengen van zijn eigen muzi...

MUZIEK• jun 24, 11:49

Who Shot Ya: Red Moons

In onze rubriek ‘Who Shot Ya’ gaan we maandelijks in gesprek met een videograaf uit de Nederlandse muziekscene om dieper in te gaan op hun carrière.

CULTURE• mei 31, 11:36

Complex Connects met Jiri11

Vallen en opstaan! Jiri11 weet als geen ander hoe het is om terug te komen na een zwaardere periode. In de derde Complex Connects sessie rapt hij over terug on top komen na een periode van blauwe brie...

Highlight Homepage• mei 23, 16:00

Artist To Watch: Kaya Imani

Kaya Imani is onze nieuwe Artist To Watch! We spraken haar over haar muzikale reis, het overlijden van haar vader en haar muzikale prestaties.

MUZIEK• mei 22, 17:55